在生成式 AI 蓬勃發展的時代,企業內容製作的流程與工具正經歷顛覆性的轉變。於近日舉辦的「Generative AI 年會」中,cacaFly 聖洋科技雲端智能中心副總經理 吳振和 CH Wu 受邀發表主題演講〈多模態與 RAG 碰撞 AI 新視界〉,以豐富實務經驗,剖析當前企業在應用 AI 圖像與影音生成時所面臨的挑戰與創新解方。

多模態生成技術發展快速,企業仍面臨落地挑戰

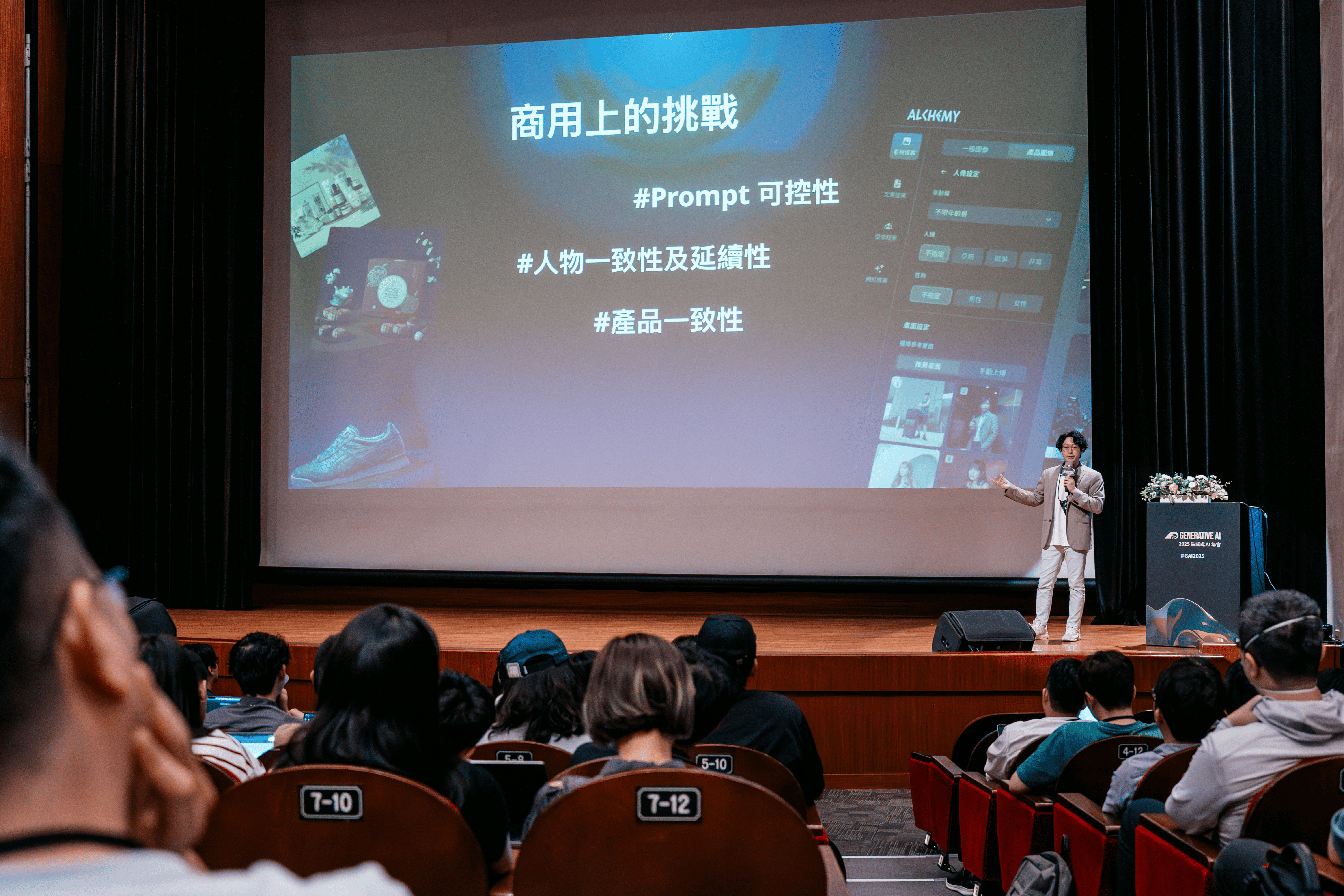

CH Wu 指出,雖然近年來多模態 AI 技術快速發展,但實際應用在廣告圖像與影片生成時,企業往往遇到三大挑戰:使用門檻高、成品不穩定,以及難以保持角色與風格的一致性。特別是在多媒體生成的情境中,相較於純文字輸出,prompt 編寫的難度更高,使用者需要反覆嘗試才能獲得符合預期的成果。

即使是有經驗的人員,也經常需要經過多輪修改,才能調整出理想的畫面風格如人物表情、肢體動作等。加上模型對語境理解的限制與幻覺現象的存在,使得生成結果不易控制,常常無法精準呈現品牌或產品核心資訊,降低實際可用性。

解構語言魔法:降低 AI 應用門檻的關鍵策略

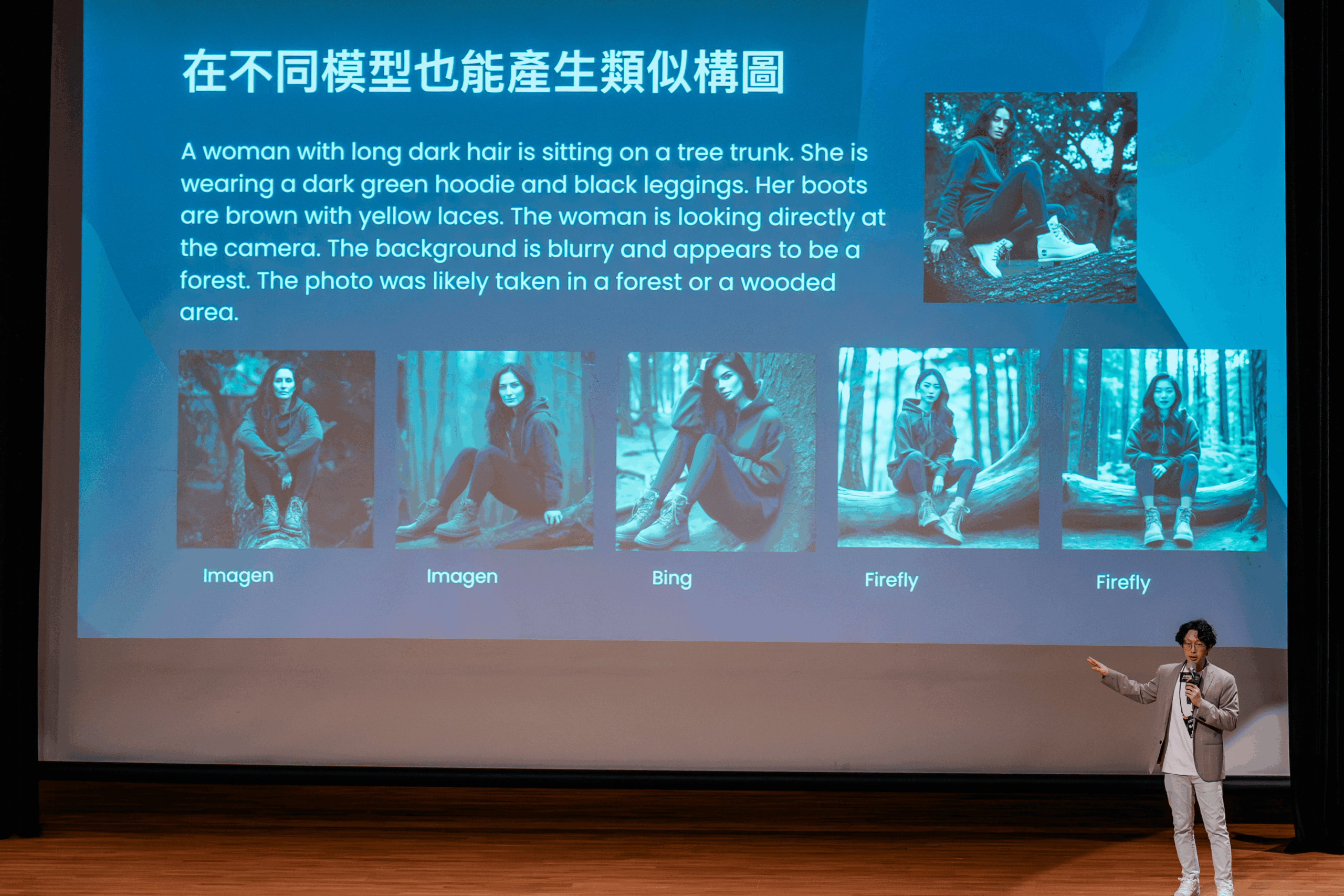

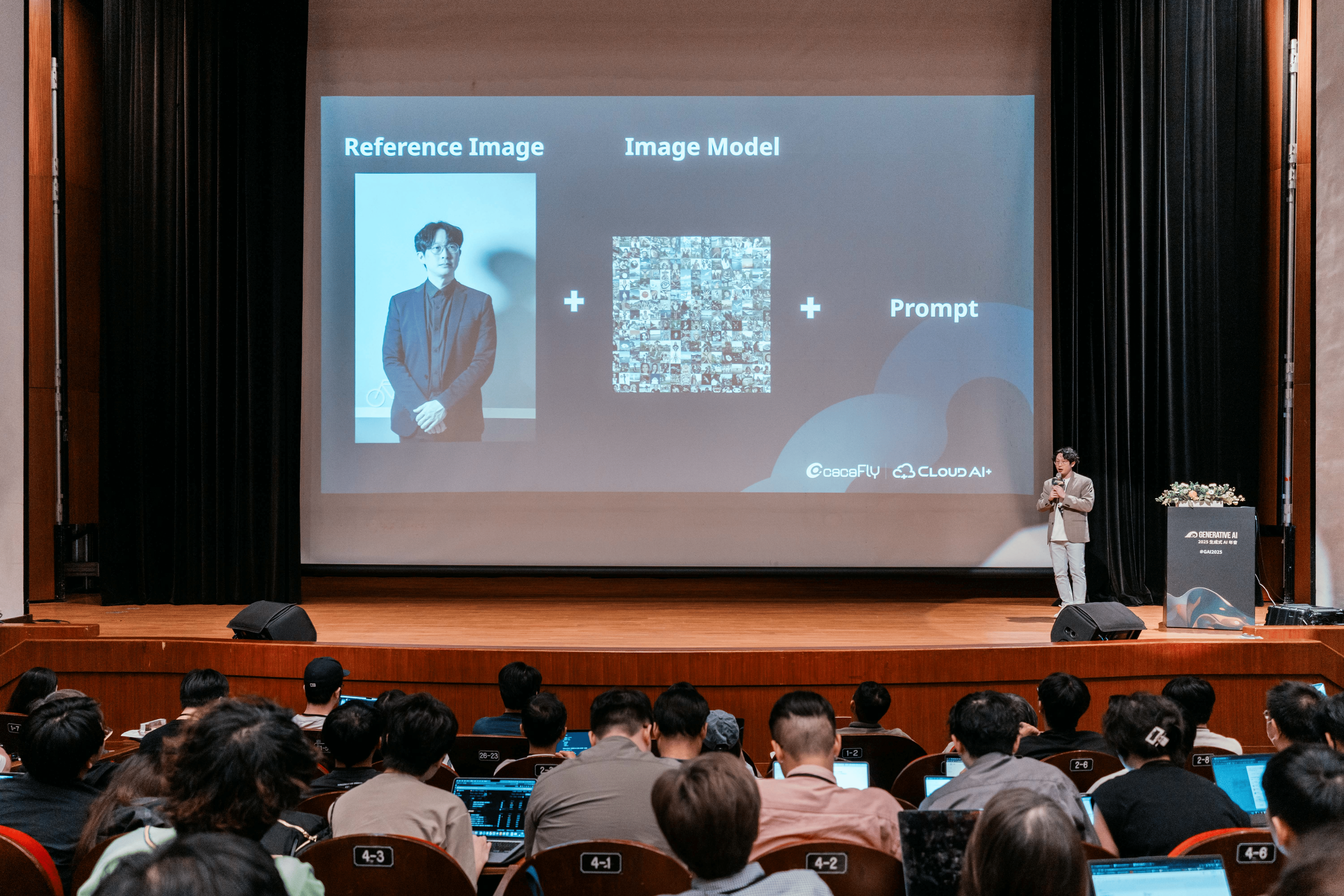

為解決上述問題,cacaFly 聖洋科技雲端智能中心發展出一套流程,協助企業更有效率地應用生成式 AI 工具。CH Wu 分享,團隊透過建立「人與 AI 溝通的翻譯器」,讓 AI 先學習大量具備良好構圖與風格的圖像,並將其解析為文字描述,再反過來使用這些文字描述進行影像生成,透過比對結果進行模型品質驗證,形成一種以自然語言驅動影像創作的可控機制。

這樣的作法不僅降低了使用門檻,也將原本專業性極高的的多媒體的問題降維成文字處理議題,讓非設計背景的行銷人員也能輕鬆上手,有效擴大 AI 應用的場景與人群。

結合 RAG 技術,打造更準確穩定的生成系統

cacaFly 也進一步結合 RAG(Retrieval-Augmented Generation)技術,將外部圖像資料庫中的高品質圖像描述語言整合進生成流程中。這讓系統在理解使用者需求時,不再依賴單一 prompt,而能透過檢索相關資料自動補全與重組提示詞,提高語意的準確度與圖像的穩定性。

實測結果顯示,使用 RAG 擴展 prompt,不論是在人物外觀一致性或產品細節維持方面,皆比純生成模式更具可控性,也更符合商業應用對品質的要求。

從靜態圖像延伸至影片,推進內容生產自動化

在廣告實務應用上,CH Wu 表示,團隊已開始導入 AI 生成流程協助產製圖像與短影片。使用者可根據產品屬性與目標族群,調整角色髮色、姿態、表情與風格,並搭配參考圖像功能,讓生成結果在視覺上更為精準一致。後續系統也可將靜態圖像延伸為影片,輸出適合社群平台與廣告素材使用的 8 秒短片,進一步提升內容生產效率。

不過他也坦言,目前影片生成的議題,在基礎模型仍存在部分技術瓶頸,包括動作描述複雜、鏡頭不夠穩定等問題,但可透過好的提示詞續調校進行優化。

創造更懂人話的 AI 協作夥伴

CH Wu 強調,生成式 AI 的價值不只來自模型能力,更重要的是是否真正理解人類的語言與需求。cacaFly 聖洋科技將持續投入資源優化 AI 工具與 prompt 撰寫流程,目標是打造出一套更直覺、可控、且能被不同部門使用者輕鬆操作的 AI 協作環境。

他期待,這樣的 AI 能力不只是為廣告而生,未來也能廣泛應用於動態看板、社群內容、電商展示等領域,真正實現創意與效率並存的企業內容生產模式。

立即與我們聯繫!開啟視覺溝通的新時代。